Qu’est-ce qui vient de se passer? Vous craignez que l’intelligence artificielle ne semble progresser à un rythme rapide, menaçant potentiellement davantage d’emplois humains ? Alors voici quelques nouvelles qui pourraient ajouter à ces préoccupations. Une équipe de chercheurs de Microsoft a annoncé une nouvelle IA qui peut imiter avec précision une voix humaine à partir d’un simple échantillon audio de trois secondes.

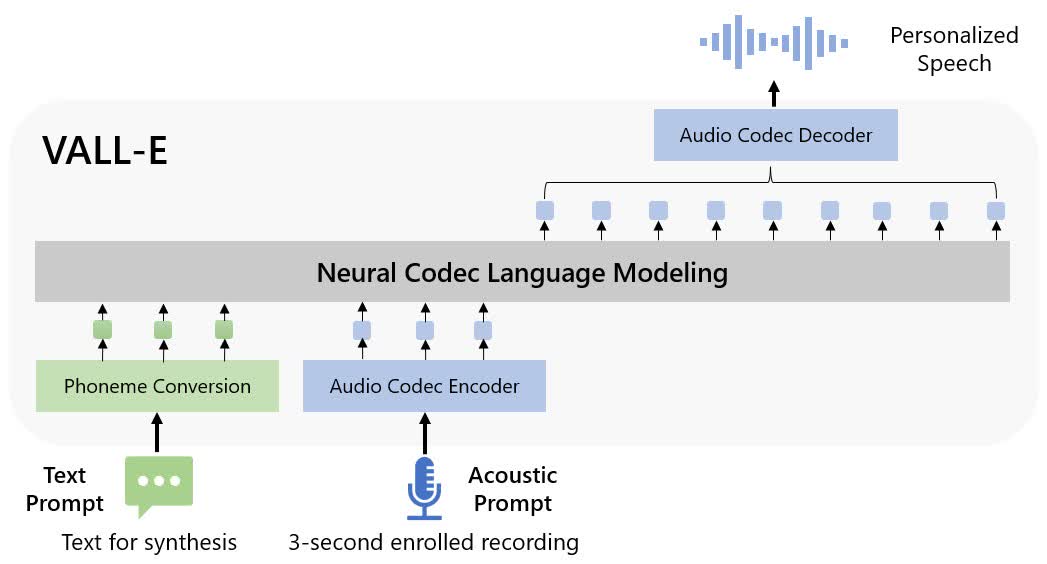

L’outil d’intelligence artificielle vocale de Microsoft, appelé Vall-E, est formé sur des « codes discrets dérivés d’un modèle de codec audio neuronal standard » ainsi que sur 60 000 heures de parole – 100 fois plus que les systèmes existants – de plus de 7 000 locuteurs, dont la plupart proviennent des livres audio du domaine public LibriVox.

Ars Technica rapports que Vall-E s’appuie sur une technologie appelée EnCodec que Meta a annoncée en octobre 2022. Cela fonctionne en analysant la voix d’une personne, en décomposant les informations en composants et en utilisant sa formation pour synthétiser le son de la voix si elle prononçait des phrases différentes. Même après avoir entendu seulement un échantillon de trois secondes, Vall-E peut reproduire le timbre et le ton émotionnel d’un haut-parleur.

Microsoft a annoncé son IA « VALL-E »

À l’aide d’un échantillon de parole humaine de 3 secondes, il peut générer une parole de texte à texte de très haute qualité à partir de la même voix. Même la gamme émotionnelle et l’environnement acoustique du

des exemples de données peuvent être reproduits. Voici quelques exemples. pic.twitter.com/ExoS2VWO6d– Tuvok @NaughtyDog (@TheCartelDel) 7 janvier 2023

« Les résultats des expériences montrent que Vall-E surpasse de manière significative le système TTS à la pointe de la technologie. [AI that recreates voices it’s never heard] en termes de naturalité de la parole et de similitude du locuteur », déclare le document de recherche, disponible à l’Université Cornell. « De plus, nous constatons que VALL-E pourrait préserver l’émotion de l’orateur et l’environnement acoustique de l’invite acoustique en synthèse. »

Vous pouvez entendre des exemples de Vall-E recréant des voix sur GitHub. Beaucoup sont vraiment incroyables, sonnant presque de la même manière que le haut-parleur bien qu’ils soient basés sur un échantillon audio aussi court. Il y en a quelques-uns qui sont un peu plus robotiques et sonnent un peu plus près des logiciels traditionnels de synthèse vocale, mais c’est toujours impressionnant, et nous pouvons nous attendre à ce que l’IA s’améliore avec le temps.

Les chercheurs de Microsoft pensent que Vall-E pourrait être utilisé comme un outil de synthèse vocale, un moyen d’éditer la parole et un système de création audio en le combinant avec d’autres IA génératives telles que GPT-3.

Comme pour toutes les IA, l’utilisation abusive potentielle de Vall-E suscite des inquiétudes. Se faire passer pour des personnalités publiques comme des politiciens en est un exemple, en particulier lorsqu’il est utilisé aux côtés de Deepfakes. Ou cela pourrait faire croire aux gens qu’ils parlent à leur famille, à des amis ou à des fonctionnaires et qu’ils transmettent des données sensibles. Il y a aussi le fait que certains systèmes de sécurité utilisent l’identification vocale. Quant à son impact sur l’emploi, Vall-E serait probablement une alternative moins chère à l’embauche d’acteurs vocaux.

Abordant les risques d’utilisation abusive de Vall-E, les chercheurs ont déclaré que ceux-ci pourraient être atténués. « Il est possible de construire un modèle de détection pour déterminer si un clip audio a été synthétisé par Vall-E. Nous mettrons également en pratique les principes de Microsoft AI lors du développement ultérieur des modèles. »