Le domaine de la génération d’images évolue rapidement. Bien que les modèles de diffusion utilisés par des outils populaires comme Midjourney et Stable Diffusion puissent sembler être les meilleurs que nous ayons, la prochaine chose arrive toujours – et OpenAI pourrait avoir frappé avec des «modèles de cohérence», qui peuvent déjà effectuer des tâches simples et ordre de grandeur plus rapide que les goûts de DALL-E.

Le papier était mis en ligne en preprint le mois dernier, et n’était pas accompagné des réserves discrètes d’OpenAI en fanfare pour ses versions majeures. Ce n’est pas une surprise : il ne s’agit certainement que d’un document de recherche, et il est très technique. Mais les résultats de cette technique précoce et expérimentale sont suffisamment intéressants pour être notés.

Les modèles de cohérence ne sont pas particulièrement faciles à expliquer, mais ont plus de sens contrairement aux modèles de diffusion.

En diffusion, un modèle apprend à soustraire progressivement le bruit d’une image de départ entièrement constituée de bruit, en la rapprochant pas à pas de l’invite cible. Cette approche a permis les images d’IA les plus impressionnantes d’aujourd’hui, mais fondamentalement, elle repose sur l’exécution de 10 à des milliers d’étapes pour obtenir de bons résultats. Cela signifie qu’il est coûteux à exploiter et suffisamment lent pour que les applications en temps réel ne soient pas pratiques.

L’objectif des modèles de cohérence était de créer quelque chose qui obtenait des résultats décents en une seule étape de calcul, ou au plus deux. Pour ce faire, le modèle est formé, comme un modèle de diffusion, pour observer le processus de destruction de l’image, mais apprend à prendre une image à n’importe quel niveau d’obscurcissement (c’est-à-dire avec peu ou beaucoup d’informations manquantes) et à générer une image source complète dans juste une étape.

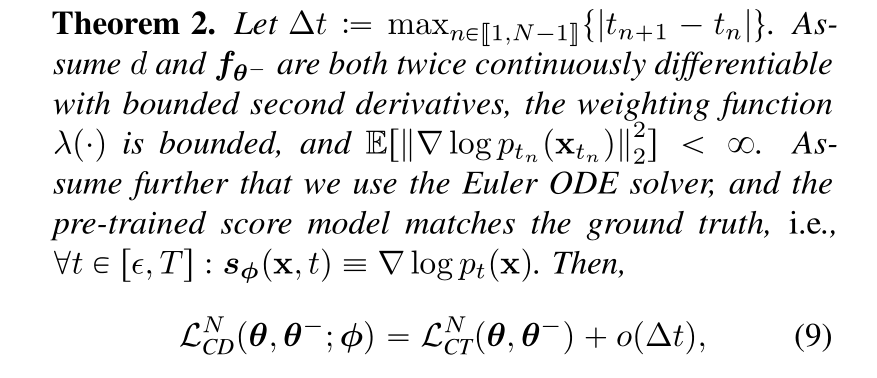

Mais je m’empresse d’ajouter que ce n’est que la description la plus vague de ce qui se passe. C’est ce genre de papier :

Un extrait représentatif du document de cohérence. Crédits image : OpenAI

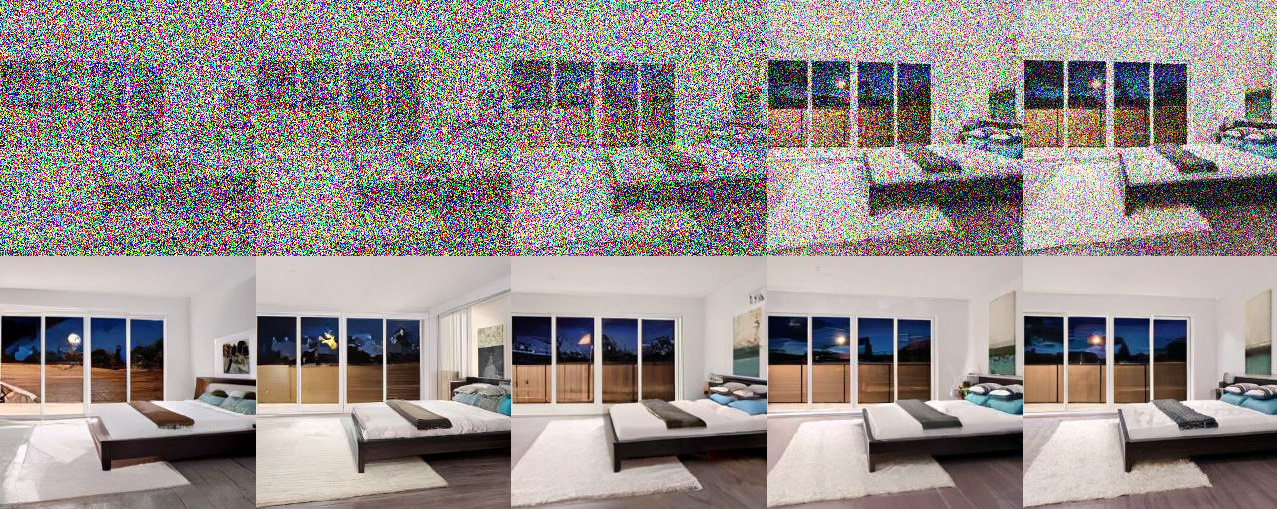

Les images qui en résultent ne sont pas époustouflantes – beaucoup d’images peuvent à peine être qualifiées de bonnes. Mais ce qui compte, c’est qu’ils ont été générés en une seule étape plutôt qu’en une centaine ou un millier. De plus, le modèle de cohérence se généralise à diverses tâches telles que la colorisation, la mise à l’échelle, l’interprétation des croquis, le remplissage, etc., également en une seule étape (bien que fréquemment améliorée d’une seconde).

Que l’image soit principalement composée de bruit ou de données, les modèles de cohérence vont directement au résultat final. Crédits image : OpenAI

Cela est important, d’abord, parce que le modèle de recherche en apprentissage automatique est généralement que quelqu’un établit une technique, quelqu’un d’autre trouve un moyen de la faire fonctionner mieux, puis d’autres l’ajustent au fil du temps tout en ajoutant du calcul pour produire des résultats considérablement meilleurs que ceux avec lesquels vous avez commencé. C’est plus ou moins ainsi que nous nous sommes retrouvés avec les modèles de diffusion modernes et ChatGPT. Il s’agit d’un processus auto-limitant car, en pratique, vous ne pouvez consacrer qu’une quantité de calculs à une tâche donnée.

Ce qui se passe ensuite, cependant, est une nouvelle technique plus efficace qui peut faire ce que le modèle précédent faisait, bien pire au début mais aussi beaucoup plus efficacement. Les modèles de cohérence le démontrent, bien qu’il soit encore trop tôt pour qu’ils ne puissent être directement comparés à ceux de diffusion.

Mais cela compte à un autre niveau, car cela indique comment OpenAI, de loin l’équipe de recherche sur l’IA la plus influente au monde à l’heure actuelle, examine activement la diffusion au-delà des cas d’utilisation de la prochaine génération.

Oui, si vous souhaitez effectuer 1 500 itérations sur une minute ou deux à l’aide d’un cluster de GPU, vous pouvez obtenir des résultats étonnants à partir de modèles de diffusion. Mais que se passe-t-il si vous souhaitez exécuter un générateur d’images sur le téléphone de quelqu’un sans vider sa batterie, ou fournir des résultats ultra-rapides dans, par exemple, une interface de chat en direct ? La diffusion est tout simplement le mauvais outil pour le travail, et les chercheurs d’OpenAI recherchent activement le bon – y compris Ilya Sutskever, un nom bien connu dans le domaine, pour ne pas minimiser les contributions des autres auteurs, Yang Song, Prafulla Dhariwal et Mark Chen.

Que les modèles de cohérence soient la prochaine grande étape pour OpenAI ou juste une autre flèche dans son carquois – l’avenir est presque certainement à la fois multimodal et multi-modèle – dépendra de la façon dont la recherche se déroulera. J’ai demandé plus de détails et je mettrai à jour ce message si j’ai des nouvelles des chercheurs.