Prospective : L’idée la plus intrigante issue de la conférence Build de Microsoft cette année est un concept tourné vers l’avenir que la société appelle la « boucle hybride », qui définit un ensemble d’applications hybrides qui couvrent l’écart entre le cloud et les appareils clients en périphérie. À un niveau de base, les applications hybrides pourront s’exécuter à la fois localement sur un PC client et dans le cloud et, plus important encore, basculer dynamiquement entre les deux.

S’il y a un endroit où vous êtes susceptible d’entendre la direction que prennent l’informatique et les applications, la conférence Build de Microsoft, axée sur les développeurs, est probablement celle-là. Fidèle à lui-même, le Build de cette année a présenté plusieurs nouveaux concepts intéressants qui ont réussi à donner une idée de la direction que prend la vision de Microsoft pour les logiciels, tout en faisant simultanément allusion à certaines technologies clés (notamment les processeurs basés sur Arm) qui, selon eux, seront nécessaires pour alimenter cet avenir.

Pour les applications hybrides, le cloud est censé être considéré comme une ressource informatique supplémentaire, tout comme un GPU peut être utilisé en plus du processeur central alimentant un PC typique. Par exemple, ces types d’applications seraient en mesure de prendre des décisions au moment de l’exécution s’il faut effectuer une inférence d’IA sur les appareils clients ou sur le cloud Azure.

De plus, comme la plupart de ces nouvelles applications sont susceptibles d’intégrer un certain niveau d’IA, elles devraient également pouvoir tirer parti des NPU (Neural Processing Units) ou d’autres types d’accélérateurs matériels d’IA. Ainsi, les applications hybrides et le concept de boucle hybride peuvent être écrits pour exploiter le CPU, le GPU et le NPU d’un appareil local et, selon les besoins ou les instructions, utiliser également des ressources informatiques basées sur le cloud.

C’est une théorie fascinante, mais il reste à voir dans quelle mesure elle peut être traduite en capacités réelles. Après tout, le concept de traitement basé sur le cloud pour les appareils clients existe depuis un certain temps déjà. Il aide à alimenter les bureaux virtuels et les clients légers, entre autres applications, et constitue la base de Microsoft Windows 365 et de sa notion de Cloud PC. Pour certains types d’environnements ou de situations, ces solutions peuvent très bien fonctionner. Cependant, les limitations de performances, les problèmes de mise à l’échelle et plus encore les ont contraints à des déploiements de niche jusqu’à présent et ils ne représentent qu’un infime pourcentage du marché global de l’informatique client.

Pourtant, tirer parti de certains des principes des environnements de cloud hybride et les appliquer au client semble certainement devoir fonctionner. L’allocation dynamique des ressources est un élément clé des architectures de cloud computing depuis les premiers jours, il est donc logique de vouloir appliquer certains de ces principes aux appareils informatiques clients. De plus, l’un des énormes avantages de l’exécution dans le cloud est qu’elle rend les problèmes d’application spécifiques à la plate-forme beaucoup moins préoccupants. De par leur nature même, les applications basées sur le cloud sont multiplateformes et indépendantes de la plate-forme matérielle.

Un grand défi est que jusqu’à présent, les applications n’ont pas été spécifiquement écrites ou optimisées pour fonctionner dans ces types d’environnements. Une partie de la vision de Microsoft consiste à utiliser des pratiques de développement cloud natives pour créer ces applications client/cloud hybrides alimentées par l’IA. En fait, plusieurs annonces de Build se sont concentrées sur de nouveaux outils permettant aux développeurs de commencer à s’habituer à ces idées. Microsoft a parlé de tirer parti de ses outils OnnX Runtime et Azure ML ainsi que d’un nouveau prototype de chaîne d’outils d’IA pour permettre aux développeurs de créer des applications qui s’intègrent dans ce modèle de boucle hybride.

Un défi pratique est que la plupart des PC actuels n’ont pas de traitement d’IA dédié. Intel et AMD en ont tous deux parlé et auront probablement plus de silicium IA dédié dans les futures parties.

Un défi pratique est que la plupart des PC actuels n’ont pas de traitement d’IA dédié. Intel et AMD en ont tous deux parlé et auront probablement plus de silicium IA dédié dans les futures parties. De plus, les efforts CUDA de Nvidia montrent que les GPU peuvent être utilisés pour les applications d’IA, mais la plupart d’entre eux ne fonctionnent que sur des serveurs. La seule option de traitement AI actuelle pour les PC basés sur Windows sont les SoC Qualcomm Snapdragon utilisés dans Windows sur les appareils basés sur Arm, y compris la Surface Pro X de Microsoft.

Malgré des livraisons très modestes à ce jour pour toute cette catégorie, Microsoft croit fermement au potentiel des PC basés sur Arm et l’a clairement indiqué via plusieurs annonces lors de Build.

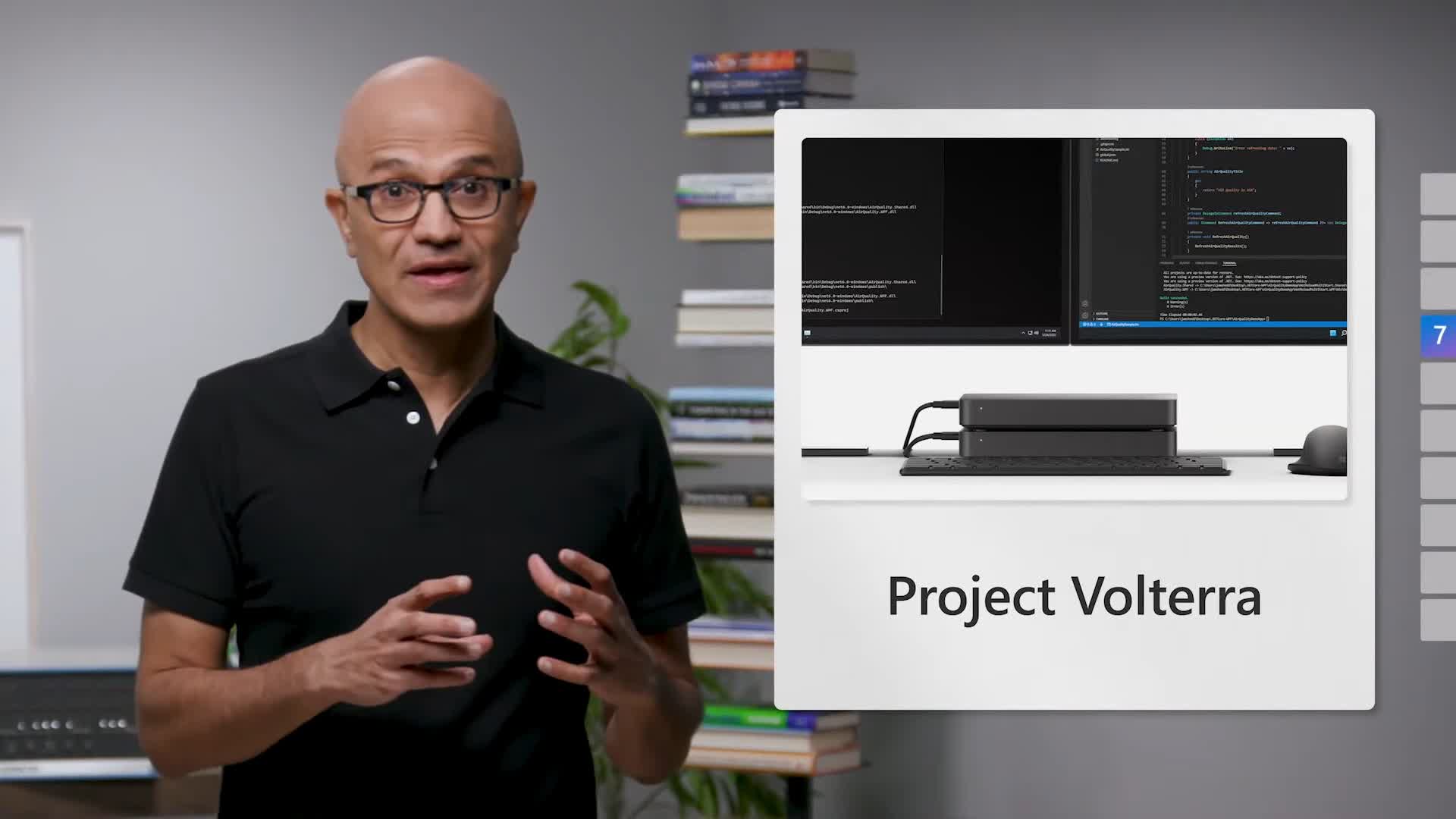

Tout d’abord, Microsoft a présenté en avant-première le projet Volterra, qui est un petit PC de bureau/kit de développement alimenté par Snapdragon. Le projet Volterra exploite le nouveau SDK de traitement neuronal de Qualcomm pour Windows et peut être utilisé pour commencer à créer ce type d’applications hybrides compatibles avec l’IA. L’outil Qualcomm exploite le Hexagon DSP intégré du Snapdragon, le processeur Kryo et le GPU Adreno que les développeurs mobiles utilisent depuis plusieurs années pour créer des applications pour smartphone alimentées par l’IA. Reconnaissant que la grande majorité des PC ont encore des processeurs x86, Microsoft a également déclaré qu’il apporterait un support spécifique au NPU à tous ses autres outils de développement Windows.

En parlant d’outils de développement, l’autre grande annonce liée à Arm de Build a été la sortie d’un ensemble complet d’outils de développement natifs Arm, notamment Visual Studio 2022, VSCode, Visual C++, Modern .NET6 et Java, et plus encore. La société a également déclaré qu’elle s’efforçait d’obtenir un certain nombre de projets open source, notamment Python, node, git, etc., pour cibler nativement l’architecture Arm. Tout cela fait partie des efforts de l’entreprise pour faire d’Arm un citoyen égal à x86 dans le monde des clients PC.

Même avec la croissance potentielle des PC basés sur Arm et des processeurs d’IA dédiés sur les PC, il reste à savoir si les architectures PC client actuelles peuvent exploiter efficacement les ressources cloud. Bien que rien n’ait été annoncé, il semble que Microsoft travaille sur de nouveaux types de conceptions et d’architectures de PC cloud qui pourraient fournir un meilleur moyen d’y parvenir. Nous verrons.

Microsoft ne s’attend pas à ce que le concept de boucle hybride décolle du jour au lendemain, donc bon nombre de ces efforts devraient s’étendre sur plusieurs années. Pourtant, il est assez intéressant de voir la direction dans laquelle l’entreprise voit le monde informatique évoluer. Il y a clairement de gros obstacles à surmonter, mais rassembler le cloud computing, l’informatique de pointe, l’informatique client, l’IA et plus encore dans un ensemble organisé qui fonctionne à travers un ensemble très hétérogène de ressources matérielles est une vision à laquelle je pense que nous allons réfléchir pendant un certain temps.

Bob O’Donnell est le fondateur et analyste en chef de TECHnalysis Research, LLC une société de conseil en technologie qui fournit des services de conseil stratégique et d’étude de marché à l’industrie technologique et à la communauté financière professionnelle. Vous pouvez le suivre sur Twitter @bobodtech.