Le secrétaire britannique à la Santé, Sajid Javid, a annoncé un examen du racisme systémique et des préjugés sexistes dans les dispositifs médicaux en réponse aux préoccupations selon lesquelles cela pourrait contribuer à de moins bons résultats pour les femmes et les personnes de couleur.

L’écriture dans le Sunday Times, Javid a déclaré : « Il est facile de regarder une machine et de supposer que tout le monde a la même expérience. Mais les technologies sont créées et développées par des personnes, et donc les préjugés, même involontaires, peuvent également être un problème ici. »

Nous examinons certains des gadgets utilisés dans les soins de santé où des préoccupations concernant les préjugés raciaux ont été soulevées.

Oxymètres

Les oxymètres estiment la quantité d’oxygène dans le sang d’une personne et sont un outil crucial pour déterminer quels patients Covid peuvent avoir besoin de soins hospitaliers – notamment parce que certains peuvent avoir des niveaux d’oxygène dangereusement bas sans s’en rendre compte.

Cependant, des inquiétudes ont été exprimées quant au fait que les appareils fonctionnent moins bien pour les patients ayant la peau plus foncée. Le NHS England et l’Agence de réglementation des médicaments et des produits de santé (MHRA) affirment que les oxymètres de pouls peuvent surestimer la quantité d’oxygène dans le sang.

Javid a déclaré au Guardian le mois dernier que les appareils ont été conçus pour les caucasiens. « En conséquence, vous étiez moins susceptible de vous retrouver sous oxygène si vous étiez noir ou marron, car la lecture était tout simplement fausse », a-t-il déclaré.

Les experts pensent que les inexactitudes pourrait être l’une des raisons pourquoi les taux de mortalité ont été plus élevés parmi les minorités ethniques, bien que d’autres facteurs puissent également jouer un rôle, comme le fait de travailler dans des emplois qui sont plus exposés aux autres.

Masques respiratoires

Les respirateurs de qualité médicale sont essentiels pour aider à protéger les travailleurs de la santé de Covid, car ils offrent une protection au porteur contre les particules grandes et petites que les autres expirent.

Afin d’offrir la meilleure protection, cependant, les masques filtrants doivent être bien ajustés et les recherches ont montré qu’ils ne conviennent pas aussi bien aux personnes de certaines origines ethniques.

« Une protection virale adéquate ne peut être fournie que par des respirateurs qui correspondent bien aux caractéristiques faciales du porteur. Taux de réussite initiaux [the rate at which they pass a test on how well they fit] varient entre 40 % et 90 % et sont particulièrement faibles chez les femmes et les travailleurs de la santé asiatiques », une revue publiée dans les notes de 2020.

Un autre publié en septembre ont constaté que les études sur l’ajustement de ces EPI se concentraient largement sur des populations caucasiennes ou ethniques uniques. « Les personnes BAME restent sous-représentées, limitant les comparaisons entre les groupes ethniques », a-t-il déclaré.

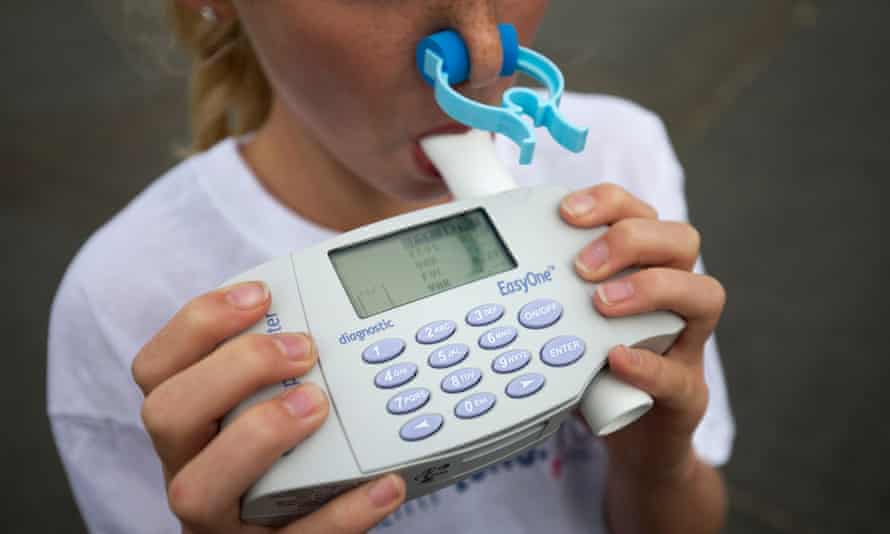

Spiromètres

Les spiromètres mesurent la capacité pulmonaire, mais les experts ont exprimé des inquiétudes qu’il existe des préjugés raciaux dans l’interprétation des données recueillies à partir de ces gadgets.

Ecrit dans la revue Science, le Dr Achuta Kadambi, ingénieur électricien et informaticien à l’Université de Californie à Los Angeles, a déclaré que les Noirs ou les Asiatiques sont supposés avoir une capacité pulmonaire inférieure à celle des Blancs – une croyance qu’il a noté peut être basée sur des inexactitudes dans des études antérieures. En conséquence, des facteurs de « correction » sont appliqués à l’interprétation des données du spiromètre – une situation qui peut affecter l’ordre dans lequel les patients sont traités.

« Par exemple, avant la ‘correction’, la capacité pulmonaire d’une personne noire pouvait être mesurée comme étant inférieure à la capacité pulmonaire d’une personne blanche », écrit Kadambi.

« Après » correction « à une capacité pulmonaire de base plus petite, les plans de traitement donneraient la priorité à la personne blanche, car on s’attend à ce qu’une personne noire ait une capacité pulmonaire inférieure, et donc sa capacité doit être bien inférieure à celle d’une personne blanche avant leur la réduction est considérée comme une priorité.

Kadambi a déclaré qu’un autre domaine susceptible d’être affecté par les préjugés raciaux est la pléthysmographie à distance, une technologie dans laquelle la fréquence du pouls est mesurée en examinant les changements de couleur de la peau capturés par vidéo. Kadambi a déclaré que ces indices visuels peuvent être biaisés par la teneur en mélanine sous la surface – en d’autres termes, la couleur de la peau.

Systèmes d’intelligence artificielle

L’IA est de plus en plus développée pour des applications dans le domaine de la santé, notamment pour aider les professionnels à diagnostiquer des affections. Cependant, certains craignent que les biais dans les données utilisées pour développer de tels systèmes signifient qu’ils risquent d’être moins précis pour les personnes de couleur.

De telles préoccupations ont été récemment soulevées dans relation avec les systèmes d’IA pour le diagnostic des cancers de la peau. Les chercheurs ont révélé que peu de bases de données d’images disponibles gratuitement qui pourraient être utilisées pour développer une telle IA sont étiquetées avec l’origine ethnique ou le type de peau. Parmi ceux qui avaient enregistré de telles informations, seule une poignée étaient des personnes enregistrées comme ayant la peau brun foncé ou noire.

C’est un problème que Javid a reconnu. Annonçant le mois dernier un nouveau financement pour des projets d’IA visant à lutter contre les inégalités raciales dans les soins de santé, comme la détection de la rétinopathie diabétique, il a noté qu’un domaine d’intérêt serait l’élaboration de normes pour s’assurer que les ensembles de données utilisés dans le développement de systèmes d’IA sont « divers et inclusifs ».

« Si nous ne formons notre IA qu’en utilisant principalement des données de patients blancs, cela ne peut pas aider notre population dans son ensemble. Nous devons nous assurer que les données que nous collectons sont représentatives de notre nation », a-t-il déclaré.