Nand Mulchandani, directeur par intérim du Joint Artificial Intelligence Center, tient sa première conférence de presse du Pentagone, le 8 juillet 2020.

WASHINGTON: Malgré quelques explosions très publiques, «nous avons reçu un soutien et un intérêt massifs de l’industrie technologique pour travailler avec le JAIC et le DoD», le nouveau directeur par intérim du Centre commun d’intelligence artificielle, Nand Mulchandani, a déclaré mercredi lors de sa toute première conférence de presse au Pentagone. Parlant deux ans après Google s’est retiré publiquement du projet Maven piloté par l’IA, Mulchandani a déclaré qu’aujourd’hui, «[we] avoir des contrats commerciaux et travailler avec toutes les grandes entreprises de technologie et d’IA – y compris Google – et plein d’autres. »

Nand Mulchandani

Mulchandani est probablement mieux placé pour vendre ce message que son prédécesseur, Le lieutenant-général Jack Shanahan, un trois étoiles de l’Air Force qui dirigeait le projet Maven et a ensuite fondé le Joint AI Center en 2018. Bien que très respecté au Pentagone, le temps de Shanahan sur Maven et ses décennies en uniforme ont créé une certaine statique dans la Silicon Valley. Mulchandani, en revanche, a a passé sa vie dans le secteur de la technologie, rejoignant JAIC l’année dernière après un quart de siècle dans les affaires et les universités.

Mais les relations avec le monde de la technologie sont toujours délicates à un moment où le JAIC, âgé de deux ans, abandonne des utilisations relativement peu controversées de l’intelligence artificielle telles que Maintenance prédictive basée sur l’IA, secours en cas de catastrophe et réponse COVID aux utilisations sur le champ de bataille. Dans juin, elle a attribué à la firme de consultants Booz Allen Hamilton un contrat pluriannuel pour soutenir son initiative de mission nationale de combat conjoint, d’une valeur maximale de 800 millions de dollars, soit plusieurs fois le budget annuel de la JAIC. Pour l’exercice en cours, a déclaré Mulchandani, «les dépenses consacrées à la lutte conjointe sont à peu près supérieures aux dépenses combinées pour toutes les autres initiatives de la mission JAIC» réunies.

Le lieutenant-général Jack Shanahan

Mais les entreprises technologiques ne devraient pas avoir de problème avec cela, a déclaré Mulchandani, et la plupart d’entre elles n’en ont pas, car l’IA dans l’armée américaine est régie beaucoup plus strictement par des rivaux comme la Chine ou la Russie. « Warfighting » ne signifie pas Terminators, SkyNet ou autres robots tueurs de style scifi. Cela signifie trier par algorithme des masses de données pour aider les combattants humains à prendre de meilleures décisions plus rapidement.

Attendez, a demandé un journaliste, Shanahan n’a-t-il pas dit peu avant sa retraite que l’armée était sur le point de tester sur le terrain sa première « mortel”AI?

« Beaucoup de produits sur lesquels nous travaillons iront dans des systèmes d’armes », a déclaré Mulchandani. « Aucun d’entre eux ne va être autonome systèmes d’armes. «

« Maintenant, nous avons des produits en cours dans le cadre de combats de guerre qui sont actuellement testés », a-t-il poursuivi. «Alors que nous pivotons [to] la guerre commune, c’est probablement le produit phare… mais cela impliquera des opérateurs, humains dans la boucle, le contrôle humain. »

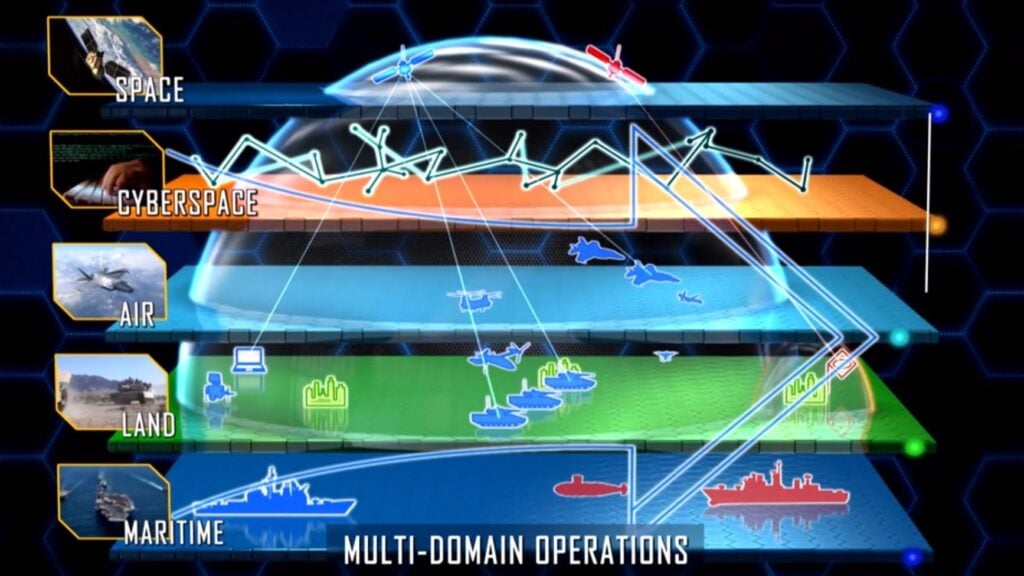

Par exemple, JAIC travaille avec le PEO-C3T (Command, Control, & Communications – Tactical) de l’armée et le Marine Corps Warfighting Lab (MCWL) sur un Fire Support Cognitive Assistant, un logiciel pour trier les communications entrantes telles que les appels à l’artillerie ou Appui aérien. Cela fait partie d’une poussée beaucoup plus large, dirigé par l’Air Force, créer un Commandement et contrôle inter-domaines (JADC2) méga-réseau qui peut coordonner les opérations des cinq forces armées à travers la terre, la mer, l’air, l’espace et le cyberespace.

Les opérations multi-domaines ou toutes les opérations de domaines envisagent une nouvelle collaboration entre terre, mer, air, espace et cyberespace (graphique de l’armée)

C’est «mortel» dans la façon dont le Pentagone moderne utilise le terme, car il contribue à l’efficacité du combat. Mais l’IA n’appuie pas sur la détente, a souligné Mulchandani. L’intérêt d’un «assistant cognitif», a-t-il dit, est «qu’il y a toujours un humain assis devant un écran qui est réellement assisté.»

C’est vrai, ce genre d’IA pouvez aider les commandants à choisir des cibles pour des frappes meurtrières. C’était un aspect du projet Maven qui en a particulièrement bouleversé certains chez Google et ailleurs.

Mais il y a une différence cruciale. Maven a utilisé l’IA pour analyser les flux de surveillance et suivre les cibles potentielles, repoussant les limites de la technologie de reconnaissance d’objets qui, selon Mulchandani, est toujours pas prêt à être utilisé à grande échelle. En revanche, pour une grande partie de la culture actuelle de l’IA de la guerre, la technologie centrale est le traitement du langage naturel: en substance, les algorithmes d’enseignement – dont la langue maternelle est 1s et 0s – comment donner un sens à une écriture normale et non structurée, les annonceurs en ligne ont investi massivement en PNL, entraînant des progrès rapides.

« Avec l’Assistant Cognitive Fires, la technologie de base là-bas est la PNL », a déclaré Mulchandani. Bien que les postes de commandement modernes utilisent des ordinateurs pour coordonner les appels à l’artillerie et au soutien aérien, ce n’est pas un processus automatisé. Si vous regardez par-dessus l’épaule d’un cible sur son écran, « il y a littéralement 10 à 15 fenêtres de discussion différentes qui se déplacent toutes en même temps », a-t-il déclaré. «Nous appliquons donc la technologie PNL à beaucoup de ces informations» pour les condenser, les structurer et mettre en évidence les éléments les plus importants.

En fait, a déclaré Mulchandani, l’armée est pleine de processus complexes, structurés de manière rigide et documentés de manière exhaustive qui conviennent naturellement à l’automatisation. Il y a longtemps, les forces armées ont compris comment former les jeunes humains à faire les choses de la même manière à chaque fois. Au lieu de faire agir les humains comme des robots, pourquoi ne pas plutôt former des algorithmes d’apprentissage automatique pour faire le travail de grognement? Après tout, les systèmes d’armes modernes et les postes de commandement reposent déjà sur de grandes quantités de logiciels – c’est juste pas particulièrement intelligent Logiciel.

«Tous ces systèmes fonctionnent sur des systèmes logiciels et matériels aujourd’hui», a déclaré Mulchandani. «Ce que nous faisons avec l’IA, c’est de les rendre plus efficaces, de les rendre plus rapides… de les rendre plus précis… de réduire la surcharge.

« Il n’y a rien de magique que nous faisons vraiment ici, à part appliquer l’IA à des processus ou systèmes déjà existants », a-t-il déclaré.

Graphique de campagne pour arrêter les robots tueurs

Bien sûr, les processus et les systèmes existants de l’armée impliquent généralement la coercition et la force meurtrière, ce qui rend les défenseurs de la vie privée et les militants pour la paix sceptiques quant à ce que fait le Pentagone, grâce à l’IA ou non. Mais Mulchandani fait valoir que le département américain de la Défense fonctionne selon des directives éthiques strictes. Par exemple, le DoD ne peut pas toucher aux données de surveillance sur les citoyens américains, et la JAIC n’investit dans aucune sorte de technologie de reconnaissance faciale.

Le règlement de longue date ici est le DoD 3000.09, qui met en place un processus d’examen élaboré pour tout système automatisé qui pourrait entraîner la perte de vies humaines – bien que, contrairement à la sagesse conventionnelle, La politique du Pentagone n’interdit pas carrément les machines à tuer automatisées. Cette année, le secrétaire à la Défense, Mark Esper, a officiellement adopté un ensemble de principes éthiques pour l’IA militaire, que la JAIC écrit déjà dans des contrats, y compris celui de 800 millions de dollars pour la guerre commune – bien que les principes ne soient pas encore juridiquement contraignants. Le JAIC a lui-même une équipe d’éthique interne dirigée par un éthicien professionnel et, tout aussi important, une équipe de test pour s’assurer que le logiciel fonctionne réellement comme prévu.

La Chine et la Russie ne prennent pas ces précautions, a averti Mulchandani. Cela ne veut pas dire ils prennent de l’avance sur les États-Unis dans l’IA bref, at-il soutenu. « Il y a des domaines où les autorités militaires et policières chinoises ont indéniablement les capacités avancées du monde, telles que la reconnaissance faciale non réglementée pour la surveillance universelle … et l’analyse de texte en chinois pour la censure d’Internet et des médias », a déclaré Mulchandani. «Nous n’investissons tout simplement pas dans la mise en place de tels systèmes de surveillance et de censure universels.»

Cependant, « pour les applications spécifiques de sécurité nationale où nous pensons que l’IA aura un impact significatif », a-t-il dit, « je crois que les États-Unis non seulement sont en tête du monde, mais prennent de nombreuses mesures nécessaires pour préserver l’avantage militaire américain sur le long terme – comme en témoigne .. par ce que nous faisons ici à JAIC. «

.