Cet article est rédigé par Rob Sobers, Varonis.

Microsoft Copilot a été considéré comme l’un des outils de productivité les plus puissants de la planète.

Copilot est un assistant IA qui réside dans chacune de vos applications Microsoft 365 : Word, Excel, PowerPoint, Teams, Outlook, etc. Le rêve de Microsoft est de simplifier le travail quotidien et de laisser les humains se concentrer sur leur capacité à résoudre les problèmes de manière créative.

Ce qui fait de Copilot une bête différente de ChatGPT et d’autres outils d’IA, c’est qu’il a accès à tout ce sur quoi vous avez déjà travaillé dans 365. Copilot peut instantanément rechercher et compiler des données dans vos documents, présentations, e-mails, calendrier, notes et contacts. .

Et c’est là que réside le problème des équipes de sécurité de l’information. Copilot peut accéder à toutes les données sensibles auxquelles un utilisateur peut accéder, ce qui est souvent beaucoup trop. En moyenne, 10 % des données M365 d’une entreprise sont ouvertes à l’ensemble des collaborateurs.

Copilot peut également générer rapidement de nouvelles données sensibles qui doivent être protégées. Avant la révolution de l’IA, la capacité des humains à créer et partager des données dépassait de loin la capacité à les protéger. Il suffit de regarder les tendances en matière de violations de données. L’IA générative verse du kérosène sur ce feu.

Il y a beaucoup de choses à déballer en ce qui concerne l’IA générative dans son ensemble : empoisonnement de modèles, hallucinations, deepfakes, etc. Dans cet article, cependant, je vais me concentrer spécifiquement sur la sécurité des données et sur la manière dont votre équipe peut garantir un Copilot sûr. dérouler.

Cas d’utilisation de Microsoft 365 Copilot

Les cas d’utilisation de l’IA générative avec une suite de collaboration comme M365 sont illimités. Il est facile de comprendre pourquoi tant d’équipes informatiques et de sécurité réclament un accès anticipé et préparent leurs plans de déploiement. Les gains de productivité seront énormes.

Par exemple, vous pouvez ouvrir un document Word vierge et demander à Copilot de rédiger une proposition pour un client basée sur un ensemble de données cibles pouvant inclure des pages OneNote, des présentations PowerPoint et d’autres documents bureautiques. En quelques secondes, vous disposez d’une proposition complète.

Voici quelques autres exemples donnés par Microsoft lors de leur événement de lancement:

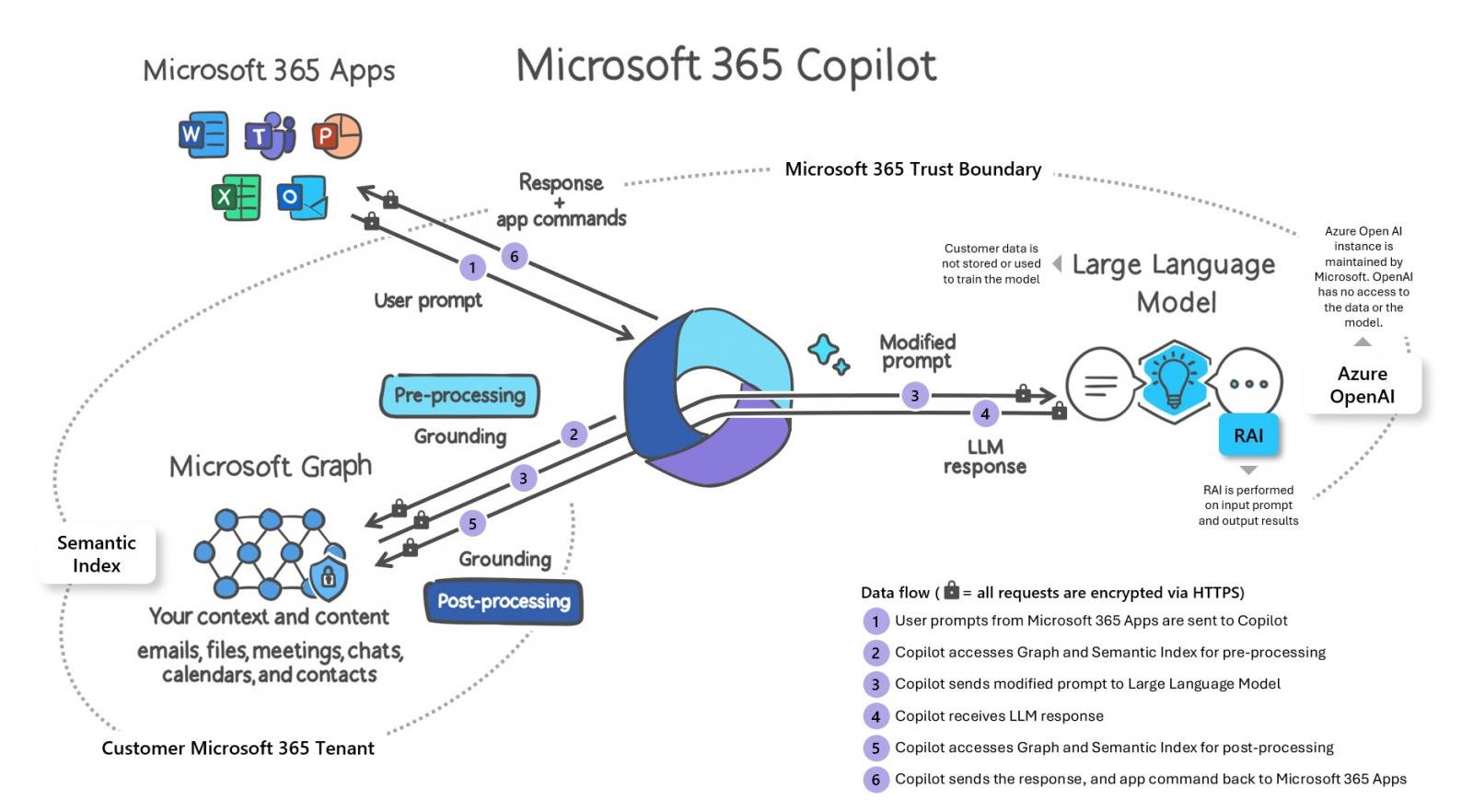

Comment fonctionne Microsoft 365 Copilot

Voici un aperçu simple de la façon dont une invite Copilot est traitée :

Modèle de sécurité Microsoft 365 Copilot

Chez Microsoft, il existe toujours une tension extrême entre productivité et sécurité.

Cela s’est manifesté pendant la crise du coronavirus, lorsque les équipes informatiques déployaient rapidement Microsoft Teams sans d’abord comprendre pleinement comment fonctionnait le modèle de sécurité sous-jacent ni dans quelle mesure les autorisations, les groupes et les politiques de liaison M365 de leur organisation étaient en forme.

La bonne nouvelle:

Les mauvaises nouvelles:

Prenons les mauvaises nouvelles une à une.

Autorisations

Accorder à Copilot l’accès uniquement à ce à quoi un utilisateur peut accéder serait une excellente idée si les entreprises pouvaient facilement appliquer le moindre privilège dans Microsoft 365.

Microsoft déclare dans son Documentation sur la sécurité des données de Copilot:

« Il est important que vous utilisiez les modèles d’autorisation disponibles dans les services Microsoft 365, tels que SharePoint, pour garantir que les bons utilisateurs ou groupes ont le bon accès au bon contenu au sein de votre organisation.

Source : Données, confidentialité et sécurité pour Microsoft 365 Copilot

Nous savons cependant empiriquement que la plupart des organisations sont aussi loin que possible du moindre privilège. Jetez simplement un œil à certaines des statistiques de Microsoft Rapport sur l’état des risques liés aux autorisations cloud.

Cette image correspond à ce que Varonis voit lorsque nous effectuons chaque année des milliers d’évaluations des risques liés aux données pour les entreprises utilisant Microsoft 365. Dans notre rapport, La grande exposition des données SaaSnous avons constaté que le locataire M365 moyen possède :

Pourquoi cela arrive-t-il? Les autorisations Microsoft 365 sont extrêmement complexes. Pensez simplement à toutes les manières dont un utilisateur peut accéder aux données :

Pour aggraver les choses, les autorisations sont principalement entre les mains des utilisateurs finaux, et non entre les équipes informatiques ou de sécurité.

Étiquettes

Microsoft s’appuie fortement sur les étiquettes de sensibilité pour appliquer les politiques DLP, appliquer le chiffrement et prévenir globalement les fuites de données. Toutefois, dans la pratique, obtenir des étiquettes travailler est difficile, surtout si vous comptez sur les humains pour appliquer les étiquettes de sensibilité.

Microsoft dresse un tableau rose de l’étiquetage et du blocage comme filet de sécurité ultime pour vos données. La réalité révèle un scénario plus sombre. À mesure que les humains créent des données, l’étiquetage est souvent en retard ou devient obsolète.

Le blocage ou le chiffrement des données peut ajouter des difficultés aux flux de travail, et les technologies d’étiquetage sont limitées à des types de fichiers spécifiques. Plus une organisation possède de labels, plus cela peut devenir déroutant pour les utilisateurs. Ceci est particulièrement intense pour les grandes organisations.

L’efficacité de la protection des données basée sur les étiquettes se dégradera sûrement lorsque l’IA générera des ordres de grandeur supplémentaires de données nécessitant des étiquettes précises et mises à jour automatiquement.

Mes étiquettes sont-elles correctes ?

Varonis peut valider et améliorer l’étiquetage de sensibilité Microsoft d’une organisation en analysant, découvrant et corrigeant :

Humains

L’IA peut rendre les humains paresseux. Le contenu généré par les LLM comme GPT4 n’est pas seulement bon, il est génial. Dans de nombreux cas, la vitesse et la qualité dépassent de loin ce qu’un humain peut faire. En conséquence, les gens commencent à faire aveuglément confiance à l’IA pour créer des réponses sûres et précises.

Nous avons déjà vu des scénarios réels dans lesquels Copilot rédige une proposition pour un client et inclut des données sensibles appartenant à un client complètement différent. L’utilisateur clique sur « envoyer » après un rapide coup d’œil (ou sans coup d’œil), et vous avez maintenant un scénario de confidentialité ou de violation de données entre vos mains.

Préparer la sécurité de vos locataires pour Copilot

Il est essentiel d’avoir une idée de votre posture de sécurité des données avant votre déploiement Copilot. Copilot sera probablement disponible pour tous dans quelques semaines, c’est donc le moment idéal pour mettre en place vos contrôles de sécurité.

Varonis protège des milliers de clients Microsoft 365 avec notre plateforme de sécurité des données, qui fournit une vue en temps réel des risques et la possibilité d’appliquer automatiquement le moindre privilège.

Nous pouvons vous aider à faire face aux plus grands risques de sécurité avec Copilot sans pratiquement aucun effort manuel. Avec Varonis pour Microsoft 365tu peux:

La meilleure façon de commencer est avec un évaluation gratuite des risques. La configuration ne prend que quelques minutes et dans les 24 heures, vous aurez une vue en temps réel des risques liés aux données sensibles.

Ce article initialement publié sur le blog Varonis

Sponsorisé et écrit par Varonis