WTF ?! Si vous êtes un joueur prêtant votre puissance GPU à une société de cloud computing appelée Salad, il y a de fortes chances qu'elle soit utilisée pour créer du contenu pour adultes généré par l'IA en échange de devises et d'objets de jeux vidéo. Oui, vous avez bien lu.

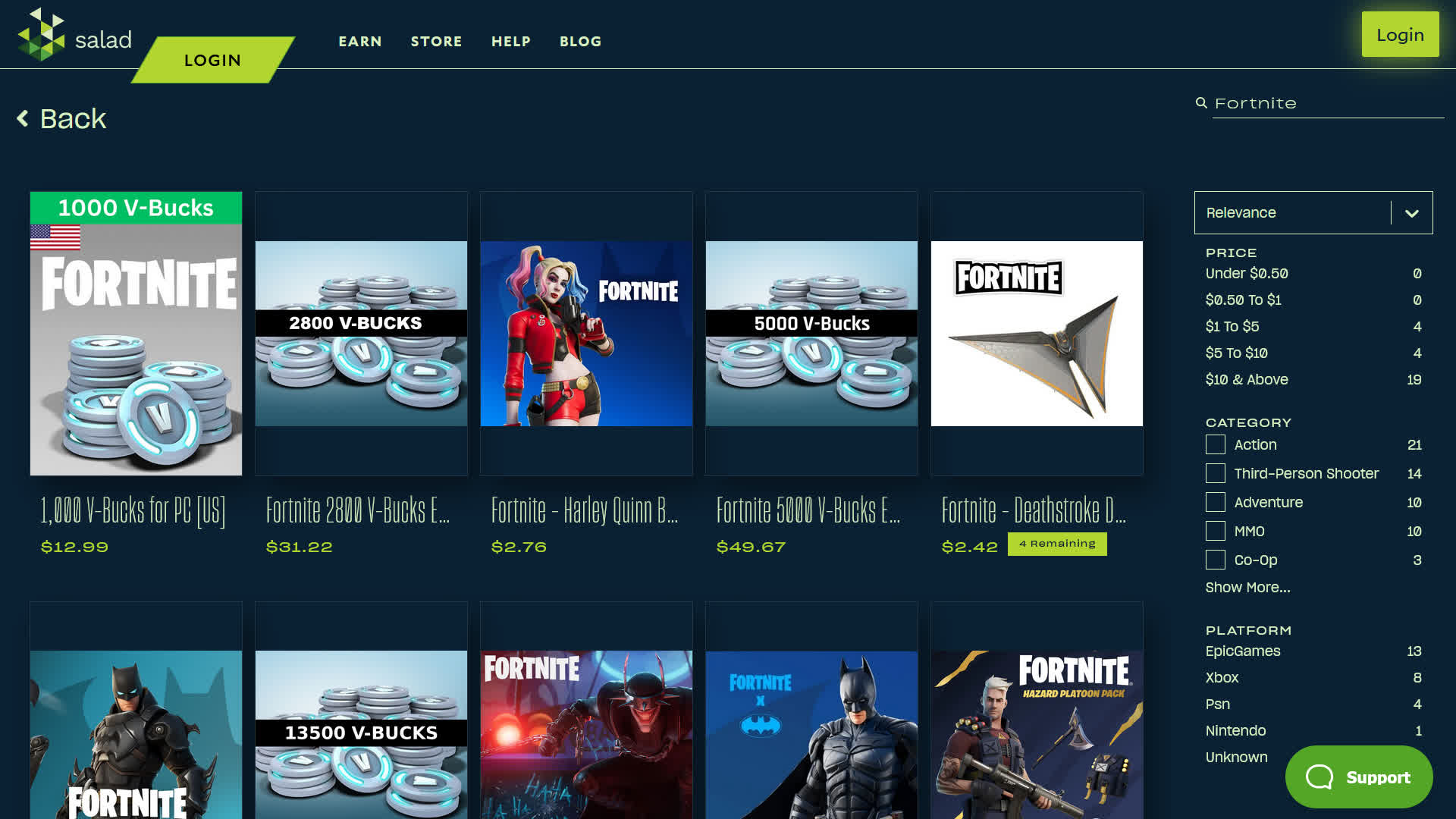

Selon un rapport de 404 Media, Salad a trouvé un moyen intelligent d'augmenter massivement la génération de contenu IA, y compris des images, des vidéos et du texte, en externalisant le gros travail de calcul vers les puissants GPU présents dans les plates-formes de jeu. Les joueurs qui s'inscrivent pour « louer » leurs GPU inactifs sont payés en produits numériques comme les cosmétiques Fortnite, le crédit Roblox, les skins Minecraft et d'autres récompenses liées aux jeux via le magasin Salad.

C'est de l'argent facile : les cartes graphiques puissantes sont bien adaptées à la puissance de traitement nécessaire pour exécuter des modèles d'IA tels que Stable Diffusion pour générer des médias. Mais voici le plus intéressant : une partie du contenu IA que Salad génère à l'aide de la puissance GPU louée est du contenu pour adultes.

Lors de leur inscription, Salad donne aux utilisateurs le choix de refuser de participer à la génération de contenu explicite pour adultes. Cependant, les mods Discord de la société auraient affirmé que par défaut, tout le monde était exclu et que certains pays n'autorisaient pas l'inscription en raison des lois locales. Le site Web de Salad suggère également que les utilisateurs qui ne génèrent pas de contenu pour adultes pourraient gagner moins d'argent.

« Il peut y avoir des moments où vous gagnerez un peu moins si nous avons une forte demande pour certaines charges de travail de contenu pour adultes, mais nous n'avons pas l'intention de placer ces sociétés au cœur de notre modèle commercial », lit-on dans un communiqué. extrait à partir de leur FAQ.

La véritable ombre apparaît avec l'implication de Salad dans Civitai, une plate-forme où des modèles d'IA sont partagés et des images sont générées. 404 Media note que Civitai a déjà autorisé la production de pornographie non consensuelle, y compris un incident particulièrement troublant où des images générées par l'IA « pourraient être classées dans la catégorie de la pédopornographie » provenant d'une autre société travaillant avec Civitai.

Ni Salad ni Civitai n’ont été transparents quant à la prévalence de la génération de contenu non consensuel et illégal parmi les rames de porno IA en cours de production. Mais étant donné les antécédents de Civitai et l'ampleur de la puissance de traitement opaque que Salad exploite, il est fort possible que des éléments foirés soient créés, à l'insu des joueurs dont les GPU sont loués.

Il s'agit d'une situation sombre, emblématique des plus grands pièges éthiques qui émergent dans le développement commercial de l'IA : des entreprises se précipitent pour revendiquer et évoluer sans garanties, transparence ou mesures de responsabilité adéquates en place.

404 Media a émis l'hypothèse que Salad marque par défaut toutes les tâches d'image de diffusion stable comme « contenu pour adultes », car il ne peut pas réellement vérifier ce que les utilisateurs individuels génèrent.

Ainsi, même si vous espérez simplement obtenir des cadeaux Fortnite gratuits en prêtant votre GPU au réseau cloud de Salad, il est possible que votre matériel produise de la dépravation numérique dans les coulisses.

Espérons simplement qu’une réglementation plus réfléchie émerge avant que les métastases de la pornographie IA non consensuelle ne transforment le secteur tout entier en un incendie de poubelle.