Après avoir sorti Gemini 1.0 Ultra et Gemini 1.5 Pro au cours des dernières semaines, Google a désormais lancé une nouvelle famille de petits modèles open source appelée Gemma. Il existe en deux variantes, une avec des paramètres 2B et une autre avec des paramètres 7B.

Ces modèles open source sont accompagnés d'une licence commerciale, ce qui signifie qu'ils peuvent être librement utilisés ou modifiés à des fins commerciales, contrairement à Gemini qui est un modèle propriétaire. La société affirme que malgré leur petite taille, les modèles Gemma sont performants et s'appuient sur la recherche et la technologie utilisées pour créer des modèles Gemini.

Les modèles Gemma peuvent fonctionner facilement sur votre ordinateur portable

Google affirme que les modèles open source Gemma sont assez petits et peuvent être facilement déployés sur des ordinateurs portables ou de bureau. Ils ont été formés sur des ensembles de données en anglais, notamment des documents Web, du code et des mathématiques.

Les modèles Gemma sont bien adaptés pour résumé du texte, génération, raisonnement, questions-réponses, etc. En ce qui concerne l'ensemble de données de formation, Google affirme que les modèles Gemma sont formés sur un total de 6 000 milliards de jetons.

Bien que les modèles soient open source, Google a fait tests approfondis des modèles pour la sécurité, les biais et les risques. Le filtre CSAM (Child Sexual Abuse Material) a été rigoureusement appliqué pour supprimer tout contenu nuisible. En dehors de cela, de nombreux filtrages de données sensibles ont été appliqués pour exclure les informations personnelles des modèles.

Google propose également une boîte à outils d'IA générative responsable permettant aux développeurs d'utiliser le modèle de manière responsable. La famille de modèles Gemma est open source, mais elle comporte quelques politique d'utilisation interdite cela empêche les développeurs de l'utiliser pour « activités dangereuses, illégales ou malveillantes« , entre autres.

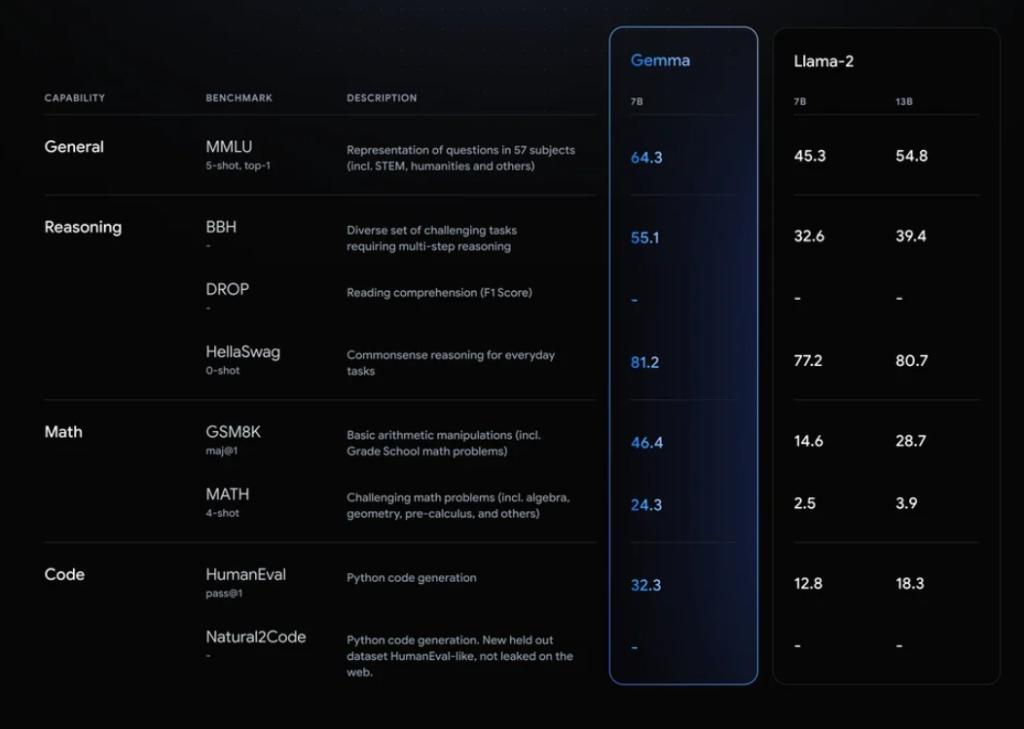

En ce qui concerne les benchmarks, le modèle Gemma 2B a obtenu un score de 42,3 au test MMLU et au Le modèle 7B a obtenu un score de 64,3. Dans le test HellaSwag, le modèle 2B a obtenu 71,4 et le modèle 7B a obtenu 81,2. En revanche, le modèle Phi-2 2,7B de Microsoft a obtenu un score de 56,7 au test MMLU et le Llama 2 (7B) de Meta un score de 45,3. Cependant, le modèle Gemini Nano 2 (3,2B) de Google a obtenu un score de 55,8 au même test.

Dans l’ensemble, je pense que Google a fait un bon pas en avant en publiant des modèles open source pour la recherche et en favorisant l’innovation. Vous pouvez commencer à utiliser les modèles Gemma sur Kaggle ou passez par l'implémentation officielle PyTorch des modèles Gemma sur GitHub (visite). Vous pouvez également consulter Gemma sur Vertex AI (visite).

Dans les prochains jours, je testerai ce modèle open source pour voir comment il se compare à d'autres modèles open source populaires. Alors restez à l'écoute pour un test pratique plus complet de Gemma, Mixtral et d'autres LLM.