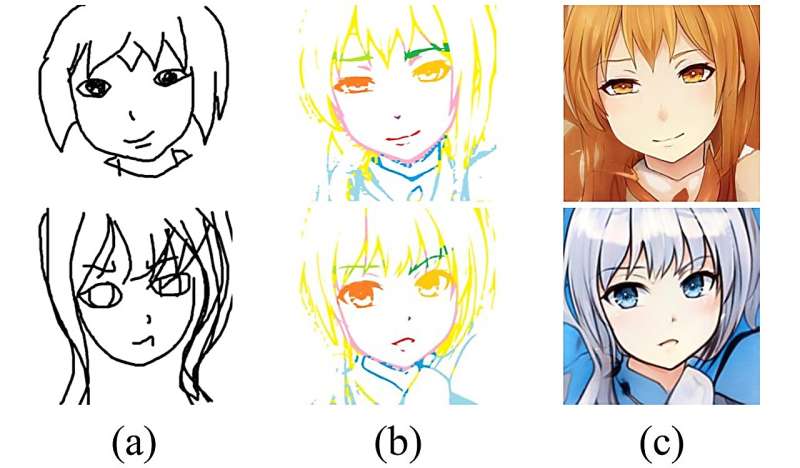

L’IA génératrice d’images est confrontée à des difficultés inhérentes à la génération d’images à partir de dessins au trait incomplets avec de petites zones manquantes et parfois même à partir de croquis complets. Le système AniFaceDrawing proposé peut générer des résultats de haute qualité qui correspondent systématiquement à l’esquisse d’entrée tout au long du processus d’esquisse. L’image représente (a) les croquis de l’utilisateur final, (b) le guidage en mode détail (les lignes de couleur représentent les parties segmentées sémantiques) et (c) les dessins en couleur générés à partir de (a) après la sélection finale de l’image de référence. Crédit : Haoran Xie de JAIST.

L’anime, l’art japonais de l’animation, comprend des croquis dessinés à la main sous une forme abstraite avec des caractéristiques uniques et des exagérations de sujets de la vie réelle. Alors que l’intelligence artificielle générative (IA) a trouvé une utilisation dans la création de contenu tel que les portraits d’anime, son utilisation pour augmenter la créativité humaine et guider les dessins à main levée s’avère difficile.

Le principal défi réside dans la génération d’images de référence appropriées correspondant aux traits incomplets et abstraits réalisés pendant le processus de dessin à main levée. Cela est particulièrement vrai lorsque les traits créés au cours du processus de dessin sont incomplets et n’offrent pas suffisamment d’informations pour que l’IA générative puisse prédire la forme finale du dessin.

Pour résoudre ce problème, une équipe de recherche de l’Institut supérieur japonais des sciences et technologies (JAIST) et de l’Université Waseda au Japon, a cherché à développer un nouvel outil d’IA générative qui offre une aide au dessin progressif et aide à générer des portraits d’anime à partir de croquis à main levée.

L’outil est basé sur un cadre d’apprentissage profond S2I (Sketch-to-image) qui associe les croquis bruts aux vecteurs latents du modèle génératif. Il utilise une stratégie de formation en deux étapes par le biais du Style Generative Adversarial Network (StyleGAN) pré-entraîné, un modèle génératif de pointe qui utilise des réseaux adverses pour générer de nouvelles images.

L’équipe, dirigée par le Dr Zhengyu Huang de JAIST, comprenant le professeur agrégé Haoran Xie et le professeur Kazunori Miyata, et le conférencier Tsukasa Fukusato de l’Université Waseda a proposé un nouveau « désenchevêtrement au niveau du trait », une stratégie qui associe les traits d’entrée d’un croquis à main levée à des attributs liés aux bords, dans le code structurel latent de StyleGAN.

Cette approche permet aux utilisateurs de manipuler les paramètres d’attribut, ayant ainsi une plus grande autonomie sur les propriétés des images générées. Le Dr Huang déclare : « Nous avons introduit une stratégie d’entraînement non supervisée pour le démêlage au niveau des traits dans StyleGAN, qui permet la correspondance automatique de croquis bruts avec des traits clairsemés aux parties locales correspondantes dans les portraits d’anime, le tout sans avoir besoin d’étiquettes sémantiques. »

Cette étude sera présentée à l’adresse suivante : ACM SIGGRAPH 2023, la première conférence pour l’infographie et les techniques interactives et la seule conférence CORE classée A* dans les domaines de recherche dans le monde entier.

En ce qui concerne le développement de l’outil, le professeur Xie ajoute: « Nous avons d’abord formé un encodeur d’image en utilisant un modèle StyleGAN pré-entraîné en tant qu’encodeur enseignant. Dans la deuxième étape, nous avons simulé le processus de dessin des images générées sans données supplémentaires pour entraîner l’encodeur d’esquisses pour les esquisses progressives incomplètes. Cela nous a aidés à générer des images de portrait de haute qualité qui s’alignent sur les représentations démêlées de l’encodeur enseignant.

Pour mettre davantage en évidence l’efficacité et la convivialité d’AniFaceDrawing pour aider les utilisateurs à créer des portraits d’anime, l’équipe a mené une étude utilisateur. Ils ont invité 15 étudiants diplômés à dessiner des portraits numériques à main levée de style anime à l’aide de l’outil AniFaceDrawing, avec la possibilité de basculer entre les modes de guidage approximatif et détaillé pour l’art au trait.

Alors que le premier fournissait des invites pour des parties spécifiques du visage, le second fournissait des invites pour le portrait complet en fonction de la progression du dessin de l’utilisateur. Les participants pouvaient épingler le generatUne fois qu’il correspond à leurs attentes, et affiner davantage leur croquis de contribution. Cet outil a également permis aux participants de sélectionner une image de référence pour générer un portrait en couleur de leur croquis d’entrée. Ensuite, ils ont évalué l’outil pour la satisfaction des utilisateurs et l’appariement des conseils au moyen d’un sondage.

L’équipe a noté que le système fournissait systématiquement un guidage facial de haute qualité et soutenait efficacement la création de portraits de style anime, non seulement en améliorant les croquis des utilisateurs, mais aussi en générant des images colorées correspondantes souhaitables. Le professeur Fukusato remarque : « Notre système pourrait transformer avec succès les croquis bruts de l’utilisateur en portraits d’anime de haute qualité. L’étude utilisateur a indiqué que même les novices pouvaient faire des croquis raisonnables à l’aide du système et se retrouver avec des dessins d’art en couleur de haute qualité.

« Notre cadre d’IA générative permet aux utilisateurs, quels que soient leur niveau de compétence et leur expérience, de créer des portraits d’anime professionnels, même à partir de dessins incomplets. Notre approche produit constamment des résultats de génération d’images de haute qualité tout au long du processus de création, quel que soit l’ordre de dessin ou la qualité des croquis initiaux », résume le professeur Miyata.

À long terme, ces résultats peuvent aider à démocratiser la technologie de l’IA et aider les utilisateurs dans leurs tâches créatives, augmentant ainsi leur capacité créative sans barrières technologiques.

Pour plus d’informations :

Zhengyu Huang et al, AniFaceDrawing: Anime Portrait Exploration during Your Sketching, Groupe d’intérêt spécial sur l’infographie et les techniques interactives Actes de conférence (2023). DOI: 10.1145/3588432.3591548

Fourni par

Institut supérieur japonais des sciences et technologies

Citation:

AniFaceDrawing: Fournir des portraits d’anime génératifs de haute qualité alimentés par l’IA pour les débutants (2023, août 2023)

(consulté le 2 août 2023)

de https://techxplore.com/news/2023-08-anifacedrawing-generative-ai-powered-high-quality-anime.html

Ce document est soumis au droit d’auteur. En dehors de toute utilisation équitable à des fins d’étude ou de recherche privée, aucun

Une partie peut être reproduite sans autorisation écrite. Le contenu est fourni à titre informatif seulement.